12 月 7 日凌晨,美国加利福尼亚州圣何塞市,AMD Advancing AI 大会上,公司正式向公众展示了 Instinct MI300 系列加速器的详细规格和性能参数,并同时展示了一系列应用部署案例,以证明其在 AI 和 HPC 领域已取得新的突破性进展。

人工智能的概念已经存在接近一个世纪了,它的发展经历了从早期的技术到现在的成熟阶段,这种演变过程使得它几乎无所不能。但是,在我们日常的工作生活中,大多数情况下我们都很难直接感受到它的力量,更多的是需要借助一些特定的时间点来认识其影响力。

2013年,在美国旧金山,早期像IBM深蓝超级计算机战胜国际象棋大师卡斯帕罗夫的时刻,至今仍然让人印象深刻。近期像是在与国际象棋天王李世石和柯洁进行的人机大战,AlphaGo取得了决定性胜利。最近最火的则是ChatGPT引发了大语言模型、生成式AI浪潮。

说实话,目前的人工智能已经过于炙手可热了,但它依然存在着巨大的潜能,因为AI无疑是未来的方向,无论它以任何形式出现,这是一个不可阻挡的大势,在人工智能领域,特别是算力的需求是前所未有的。

根据AMD内部对2023年全球数据中心AI加速器市场规模的一年前估计,该市场的潜在价值约为300亿美金,在今后的几年里,它的增长速度将以每年50%的速度持续下去,并将在未来几年达到1500亿美金的高度。

看起来现在需要更精确地估计市场潜力,AMD预估2023年和2027年数据中心AI加速器的规模已由最初的保守估测上调为分别达到400亿美元和4500亿美元,并且复合增长率超过70%。

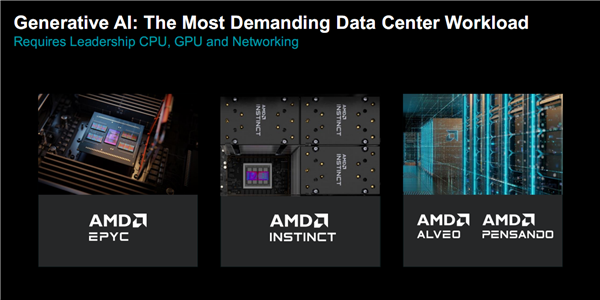

作为拥有全面解决方案的领先者,AMD能够从多个维度充分满足于AI尤其是生成式AI方面对强大计算能力和广泛适用性的需求。

我们拥有世界最先进的EPYC处理器及不断增长的Instinct加速器来支持CPU方面的运算;而在GPU方面,则有Alveo和Pensando这样的技术创新以加强我们的计算能力;而作为软件的基础平台,我们还有ROCm开发环境提供支持,以此形成一个有机的整体解决方案。

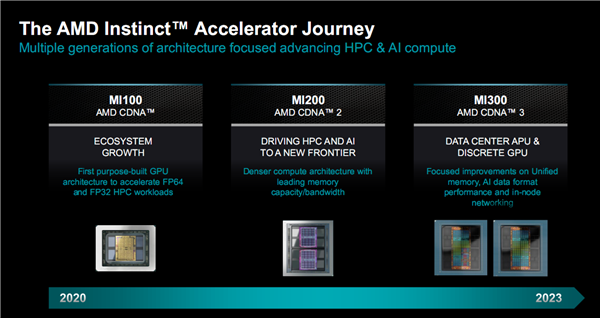

AMD早期的图形核心部分来源于其游戏显卡所使用的RDNA架构,这导致其在面向计算机视觉、人工智能等应用时缺少直接支持,于是诞生了专为计算领域设计的CDNA架构。

第一代产品的Instinct MI100系列是一款采用专门架构的显卡,它可为高性能计算(HPC)任务提供加速功能,并且在众多超算平台上表现卓越。

第三代Instinct MI300系列基于全新的CDNA3架构,可以看做是之前MI200系列的升级版本,它分为两大路线:数据中心APU和专用GPU。重点改进的是其在内存、AI性能及节点网络方面的表现,同时在先进封装及更高的能效水平上也有了显著提升,以适应生成式AI的强劲需求。

Instinct MI300X:1920亿晶体管怪兽 完胜NVIDIA H100

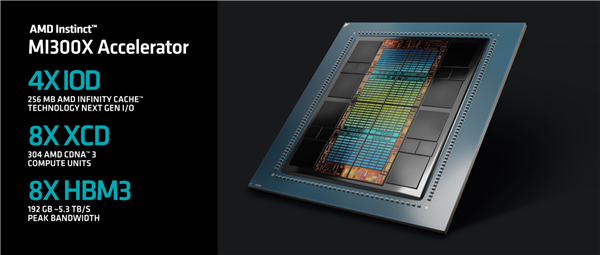

Instinct MI300X 属于传统图形处理器增强解决方案,其采用的是专有的 GPU 设计,且它采用了最先进的 CDNA 3 计算架构。

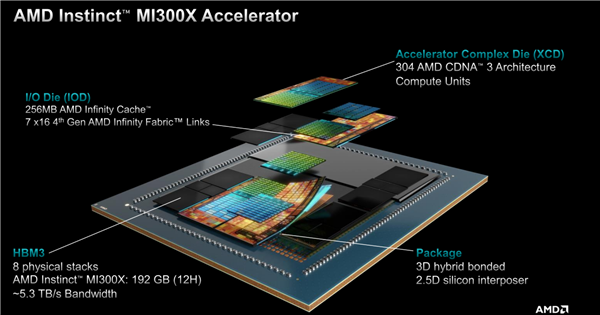

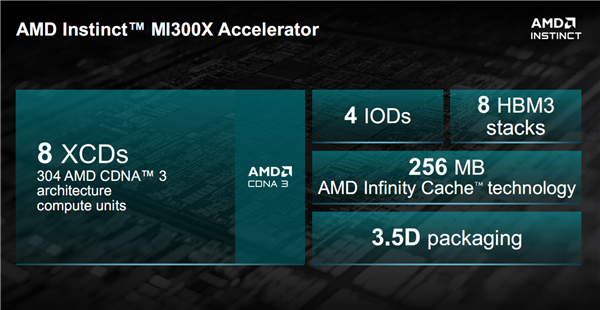

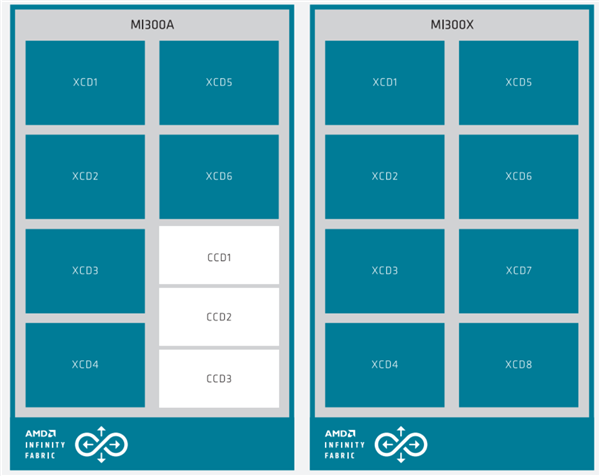

它是基于8个XCD加速计算模块(Accelerator Compute Die)实现的,每一块XCD含有38个协同处理单元(CU)。共计有304个这些单元。

每个XCD组与它底下的IOD模块相连,IOD模块负责连接输入输出和通信。总共四个IOD提供了多达七条满血的第四代Infinity Fabric连接通道,并且总带宽最高可达896GB/s,还有256MB Infinity Cache无限缓存。

XCD以及IOD外围中采用了8颗HBM3高带宽内存,其总的储存容量达到192GB,具备高达5.3TB/s的超高速数据传输速率。

进入AI与高性能计算时代,HBM内存被看作是提供高性能的最好选择。 AMD早先就推广了HBM的应用以及其普及,对推动该技术的实施有着重要意义。

这些所有的模块全部以2.5D的硅介质作为中间层和3D混合连接等技术组装成一体,AMD称其为3.5D封装技术。

总计约有1530亿颗晶体管,其中XCD芯片的部分采用的是5纳米的先进制造工艺;另外一部分则采用了6纳米的先进技术。

顺便提及一下,图中的小号硅片位于 HBM 内存之间的位置,每组内共有 8 颗,它们并没有实际的计算和传输功能,而是起到支撑作用,确保整机结构稳固。

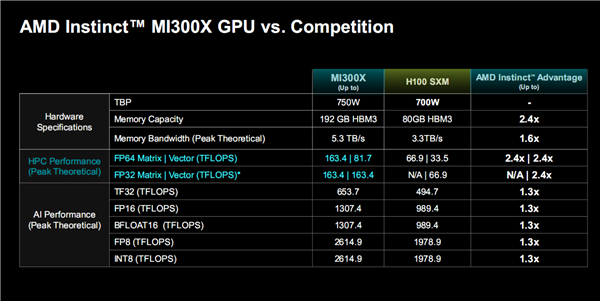

MI300X 的各项技术特性都领先于 NVIDIA H100(H200已经在规划中,预计明年第二季度上市,因此暂未有对比)。

在高性能计算(HPC)领域,MI300X FP64双精度浮点矩阵和矢量性能达到了惊人的163.4万亿次每秒(TFlops),而单精度浮点性能则为163.4万亿次,这两款GPU的FP64版本分别与H100的2.4倍、无限倍以及2.4倍。然而,并不支持FP32矩阵运算功能。

在AI方面,MI300X TF32的单精度浮点计算能力为653.7T FLOPS,并且具有H100的一半性能;同时,半精度浮点(FP16)和BF16(浮点、半精度浮点混合模式)的能力分别是它的两倍,达到1,307.4TFLOPs;此外,它还具备INT8整数能力,其能力为2,614.9TFlops。

TensorFloat32是一种新型的浮点精度标准,它在保持与FP16相同精度的同时,将尾数位也增加到了10位。同时,它同样也保持着与FP32相同的动态范围(指数位也为8位)。

BF16是一种用于深度学习的优化浮点格式。

此外,适用于HBM3高速内存,M300X无论是存储容量还是带宽上均全面碾压H100,且其整体能耗仅有750W,与H100的能耗700W相比提升了一小部分。

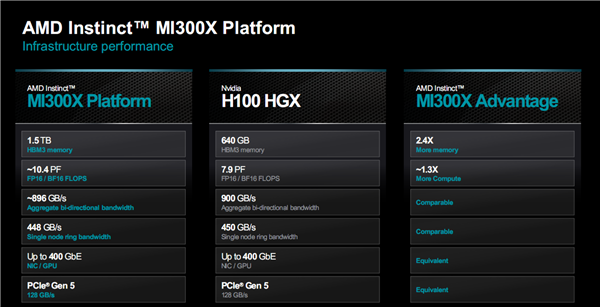

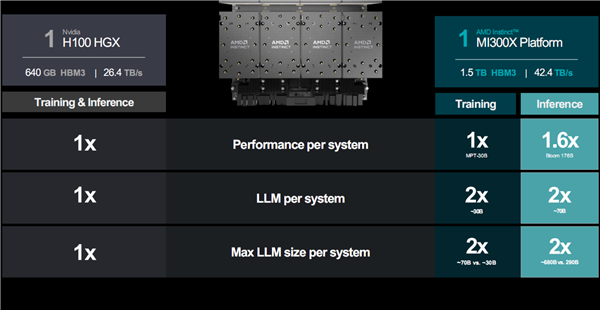

AMD 还设计了 MI300X 平台,八枚 MI300X 互相并行连接,能够兼容任何 OCP 兼容的计算架构系统。

如此一来,私家侦探,侦探公司,调查公司,查人找物,商务调查,出轨外遇调查,婚外情调查,私人调查,19209219596在单个服务器的空间内就有2,432个计算单元和1.5TB的HBM3内存以及高达42.4Gbps的内存带宽。

性能提升直接飙升,在Fusion Pro 1.5版本中,GPU性能突破性地提升到10 P FLOPS,即每秒钟能够进行1亿亿次运算。这意味着,它已经达到了目前市场上大型机或超大型机的表现,堪称相当强劲的算力。

相较于由同八颗H100构成的计算平台HXG,后者不仅具备更卓越的运算效能与HBM3储存能力,而且在带宽、数据传输效率上也显得较为均衡,不过其性能表现较HXG略逊一筹。

尤其是在每一台GPU上可供训练的大模型都大为增加的情况下,这些系统的整体性能将会得到显著的增强。

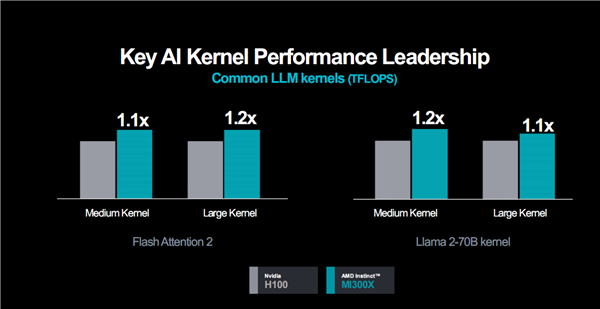

关于实际应用性能的表现部分,AMD提供了有关H100的一些详细数据,进行对比的对象则为其他GPU。

通用大语言模型,无论是中等还是大型内核,都可以领先10-20%。

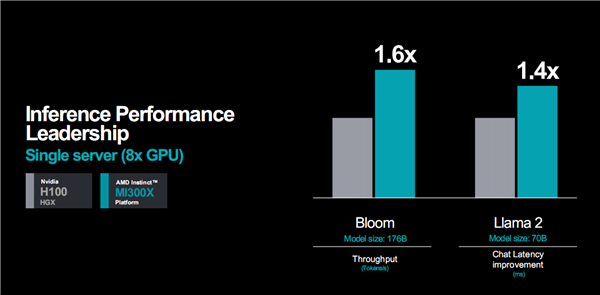

推理性能,都是八路并联的整套服务器,1760亿参数模型Bloom的算力可领先多达60%,700亿参数模型Llama 2的延迟可领先40%。

性能同样优秀,无论是在计算能力上还是其它方面,八路服务器中的MPT模型与300亿参数模型相比完全相同。

总的来说,无论是针对人工智能的推理应用还是AI训练过程,MI300X平台都远优于H100平台,很多时候这种优势甚至会翻倍。

产品强大的同时也离不开合作伙伴的助力,MI300X已经获得了众多OEM厂商和解决方案供应商的认可,比如惠普(HPE)、戴尔、联想、超微等知名品牌,以及技嘉、鸿佰(富士康同门)、英业达、广达、纬创、纬颖等知名企业。

具体来说:戴尔的PowerEdge XE9680服务器配备了四组的八块MI300X。另外联想也将在2024年登场,他们产品的超微H13采用第四代EPYC处理器与MI300X加速器进行搭配。

在基础架构中引入MI300X的合作伙伴也相当不少,包括:Aligned、Arkon Engergy、Cirrascale、Crusoe、Denvr Dataworks、TensorWare,等等。

关于客户方案方面,例如微软发布的Azure ND MI300X v5系列虚拟机,包括甲骨文推出的裸金属AI实例,还有Meta (Facebook)数据中心的加入,以及对Rocm 6 Llama 2大模型优化的认可。

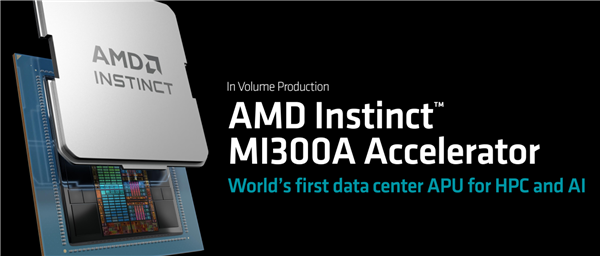

Instinct MI300A,全球首款集成了计算功能的APU,将冲击实现二百亿亿次。

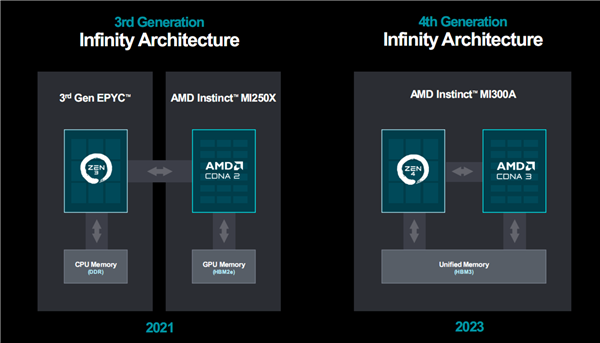

如果MI300X是传统GPU加速器的一个提升的话,那么MI300A则是彻底革新的一步,AMD实现了这个领域的突破。

相比之下,NVIDIA Grace Hopper虽然也是CPU、GPU合体,但彼此是独立芯片,需要通过外部连接,放在一块PCB板上,层级上还差了一个档位。

Intel规划的融合方案Falcon Shores因为各方面原因已经暂时取消,短期内还是纯GPU,未来再冲击融合。

MI300A是首款为AI与高性能计算(HPC)目的而设计的APU加速器,它集成了Zen3 CPU与CDNA3 GPU这两款核心功能于一体,并采用了统一使用的HBM3内存及Infinity Fabric高速总线连接技术,极大地简化了整体结构与编程应用。

这种通用架构在多个方面都表现出明显的优势。

首先,让CPU和GPU实现内存资源共享;其次,避免因重复复制传输数据而造成网络拥堵;第三,在不需分离存储与计算的情况下进行运行处理工作。

二是共享无限缓存,数据传输更加简单、高效。

三是动态功率平衡,不管计算能力着重CPU还是GPU,都能及时调节,更为精准有效,能源利用效率也更高。

四是对编程的简化有助于我们实现对CPU和GPU等资源的有效利用。我们可以将这些系统并入到同一个编程体系中,使其可以相互协调工作,并不需要为每个任务分别编写特定的程序。

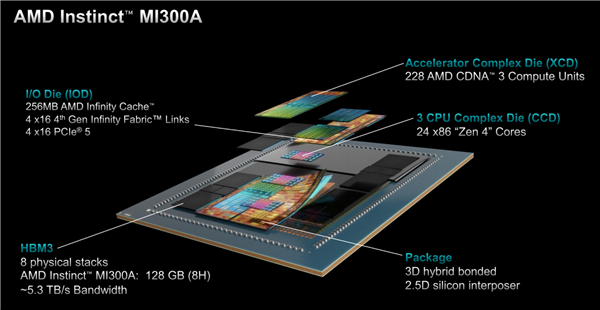

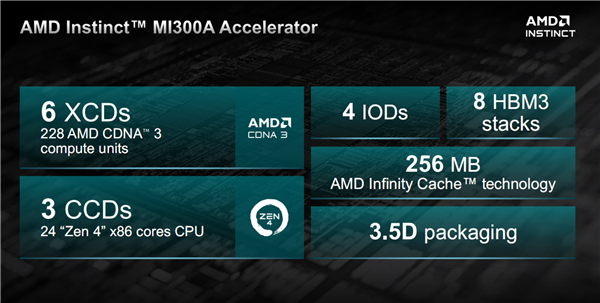

MI300A拥有六个XCD模块,其计算单元总数量达到228个,而另外两个位于MI300X上的CCD换到了三个XCD上,增加了总计24个CPU核心。这些核心与第四代EPYC 9004系列的CCD完全相同,并且可以直接复用。

四个IOD、无限缓存以及八颗HBM3内存都完全相同,只是HBM3内存的厚度从12H堆叠变为8H堆叠,并且每颗容量从24GB降为16GB,总容量仍然是128GB;但带宽仍然是5.3TB/s。

晶圆总产出约为1460亿片,具体来说,XCD工艺和CCD工艺都是3纳米,而IOD方面则使用6纳米,而且所有的组件均采用独立式Socket封装,可以视为封闭接口。

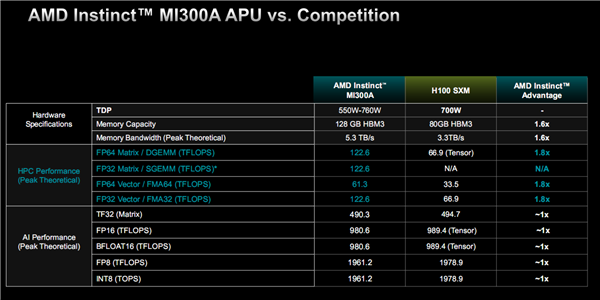

在性能方面,MI300A FP64矩阵/矢量运算速度达到HJ100的1.8倍(不支持FP32矩阵),而T私家侦探,侦探公司,调查公司,查人找物,商务调查,出轨外遇调查,婚外情调查,私人调查,19209219596F32、FP32、BF16、INT8等其它格式都达到了同样的效能。

包括Fp64矩阵、Fp32/矢量性能,两者均为122.6TFlops,而Fp64矢量性能则为61.3TFlops,均相当于Ml300x的75%。

TF32性能493.0TFlops,FP16、BF16性能980.6TFlops,FP8、INT8性能1961.2TFlops,同样也是MI300X的75%。

为什么只有XCD模块是75%呢?原因是该模块少了整个模块的四分之一,所以GPU的核心自然也会减少其四分之一,也就是在这里我们只是在讨论GPU性能而忽视了CPU的部分。

M300A的整机功耗大致在550-760w之间,具体取决于频率的变化范围。

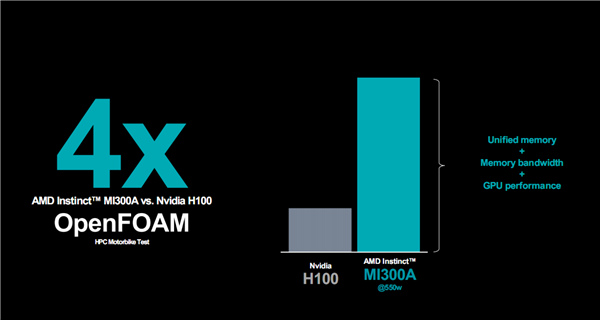

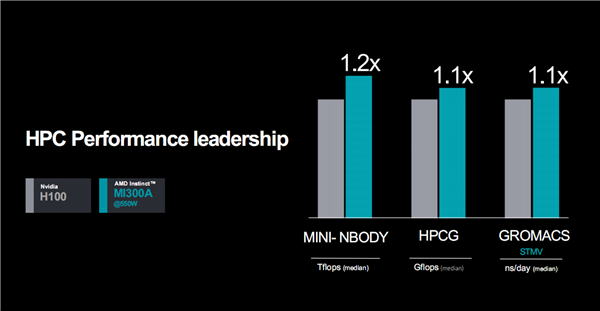

相比于H100,基于GPU的AI加速卡MI300A只需要550瓦的电源输入就能够帮助用户在OpenFOAM高性能计算测试中获取多达4倍的性能优势,并且根据具体的应用场景,在不同水平上可以实现领先10%到20%的优势。

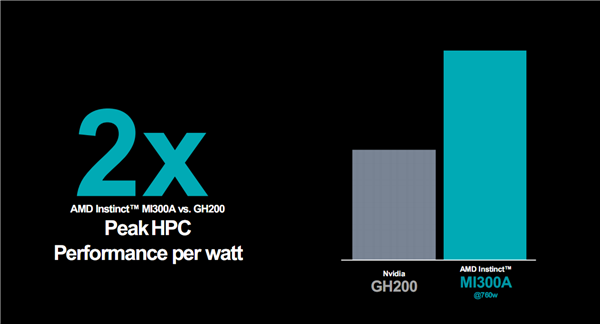

比较最新款GH200,MI300A 760W的最大功率下的效率表现,这更是达到了2倍的优势。

已经将MI300A软件包装入了美国劳伦斯利弗莫尔国家实验室的下一代超级计算机ElCapitan系统中。

它的设计目的是要达到200亿亿次的世界最高速度,这也是世界第二套以AMD为硬件基础的超级计算机。

“MI300A”系列的产品合作伙伴也持续拓展,现在已经有慧与、Eviden(隶属于法国公司Atos)、技嘉以及超微等企业成为OEM或方案合作伙伴。

慧与EX255a将成为第一个基于Mi 300A的超级计算加速器刀片服务器,在2024年初开始销售。

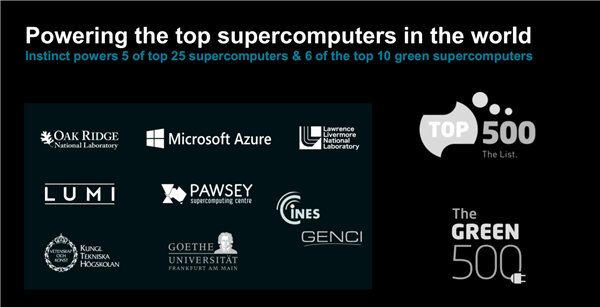

目前,AMD的Instinct加速器产品已经在众多企业、高校及科研机构中得到了广泛的应用。其在超级计算机领域的表现尤其突出,在最新的超算500排行榜上拿下了前25名中的5个席位,包括第一名美国橡树岭国家实验室Frontier以及第五名芬兰LUMI等都使用了MI250X加速器。

此外,Instinct加速器也在GreenSuperComputing 500排名中占据七个前10名的位置。在这一名单中,它独揽六个顶级型号的前三席:MI250X排第二、MI210第三,这两款型号表现出色,性能卓越。

这也是一项重要的里程碑,AMD致力于在2020-2025年间将服务器处理器以及AI/HPC加速器的能效提升达到30倍的目标。

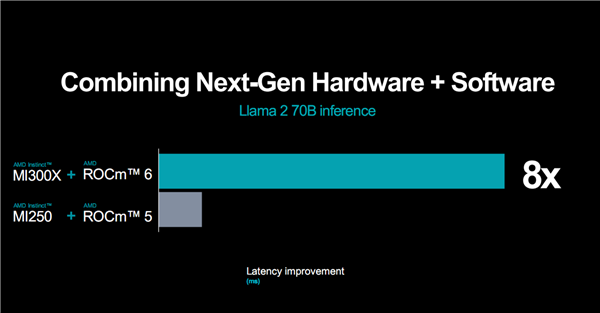

软硬件结合加速性能提升8倍

如好马需要配以好鞍一样,显卡也需要借助相应的驱动来最大化其性能效能,在 AI/HPC 加速器的使用中也同样如此,优秀的开发平台和工具对加速器的高效发挥必不可少。

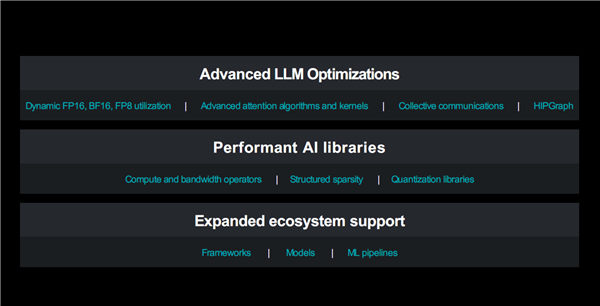

AMD推出的ROCm就提供这样的一个开源软件平台,并且现在是迎来了全新的版本ROCm 6。

它聚焦于增强对大型语言模型和生成性AI的优化与改进,同时强化对开源社区的支持,促进生态系统的发展,并且加入更多的深度学习工具包来提高其性能和可扩展性。

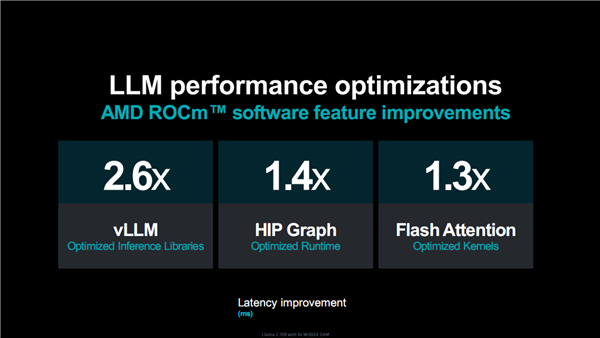

例如,在大型语言模型的改进过程中,我们开发了开源的大模型推理加速工具vLLM,并优化了相应的推理引擎,从而提高了计算延迟2.6倍。

支持高性能图形分析学习框架HIGraph,该框架能够加速代码运行,并且提升了性能效率高达1.4倍。

支持更有效的内存处理能力的注意力算法 FlashAttention ,能有效地减少内核操作的时间,并提高 1.3 倍。

新一代硬件配合新一代开发平台,其威力之强大是显而易见的。例如:Mi300x以及rocM6可以与Mi250X和rocM5搭配,在运行270亿参数的lalamark2模型推理方面,比前者性能提高了8倍!

当然 ROCm 6 平台将逐步支持旧型态的硬件从而进一步挖掘其潜能。

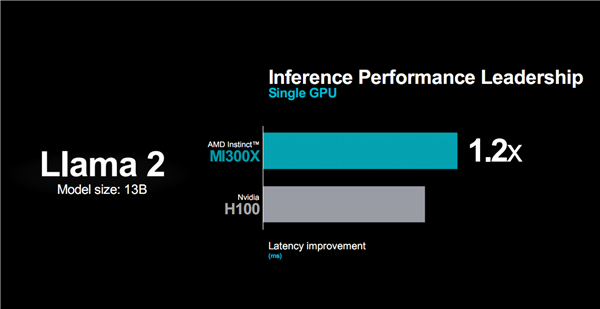

相比之下,比如具有130亿参数的Llama 2大模型,我们的产品Mi300X在延时表现方面比后者快了20%。

在生态支持方面,ROCm 6也在加速扩展,特别依托于AMD一贯倡导的开源和开放路线,一方面积极为开源社区贡献自家开发库的同时,也可有效利用诸如Hugging Face、PyTorch、TensorFlow、Jax、OAI Triton、ONNX等各类型开源AI框架、模型和算法。

OpenAI将在即将到来的Triton 3.0版本里启用对AMD显卡的支持,这意味着未来与你进行对话的ChatGPT背后的逻辑运算器很可能也是AMD的Instinct系列。

总的来说,AMD新Instinct MI300X/MI300A加速器在技术规格上非常出色,拥有着超一流的硬件设计以及全球最先进的算力与效能,并且特别值得关注的是其融合的APU,在业界中处于最尖端水平,为市场开拓了全新的可能。

加上EPYC CPU处理器以及相应的网络解决方案,这一强大计算平台能够支持生成式AI推理、训练以及应用需求。

在软件开发、生态合作上,AMD同样积极与时俱进,开放拥抱社区、拥抱产业,简化开发与应用流程,大大增强了自身竞争力,前途无量,值得期待。

PS:

至于是否有特别为中国设计的版本, AMD 的官方回答是:

“在中国市场,AMD扮演着非常重要的作用。今日并无推出面向该市场专属产品的决定。”

顶: 98286踩: 2

评论专区