北京时间2020年8月4日23时,在全球权威的机器学习基准评测组织MLCommons®发布MLPerf® Storage v2.0测试结果中,深圳市泛联信息科技有限公司(UBIX Technology Co., Ltd)参与了全部10项测试场景,其中7项取得了第一名的成绩。这一骄人成绩不仅体现了泛联信息(UBIX)在高性能全闪存储系统领域的技术领先优势,并且证实了其产品在支撑大规模的AI训练和推理任务中的强大能力。

MLPerf®存储v2.0标志着人工智能存储性能的新标淮

由全球权威 AI 基准测试组织 MLCommons® 推出的MLPerf® Storage v2.0 是最新一代人工智能存储性能评测标准,它旨在评估真实的人工智能工作负载下,存储系统支持训练与推理流程的能力。这个评测套件是为面向AI时代的数据密集型应用专门设计的,它不仅考量传统性能指标,如吞吐带宽和IO吞吐量等,更重要的是考量在大规模并发、海量数据处理、大模型训练及Checkpoint保存与恢复等典型场景中的系统表现能力。

本次测试吸引了来自全球26家顶级科技公司的参与,涵盖了存储系统、AI基础设施及半导体三大核心领域。其中不乏包括泛联信息(UBIX)这样创新型企业,也包含有IBM、Huawei、HPE、DDN、Intel、Samsung、Micron、Kioxia、Lightbits Labs、H3C、Oracle、Nutanix等全球知名企业,该测试的广泛认可度与影响力体现了在科技领域中的国际地位和影响力。

本测试结果基于由各参与公司提供的数据。

2023年5.0版和2024年1.0版的MLPerf® Storage v2.0新增了基于不同规模的llama-3模型的6个测试场景,覆盖图像识别与科学计算等领域的人工智能应用,全方位检验典型数据加载、checkpoint保存及恢复等模型训练工作负载的存储需求。

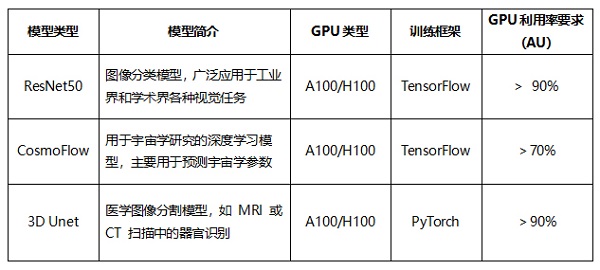

对A100和H100两种GPU分别定制了三个不同场景,即3D Unet模型的测试环境。这个实验总共包含了6个场景,分别是ResNet50的测试情景、CosmoFlow 3模型的测试环境以及两个未指定场景。

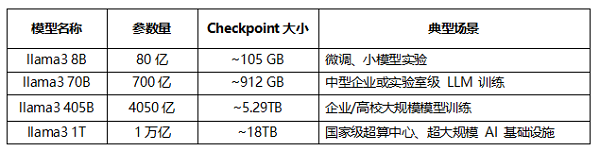

在MLPerf® Storage v2.0版本中新增了四个Checkpoint测试用例,旨在模拟AI模型训练过程中的检查点保存与恢复工作负载。这些测试用例重点测试checkpoint的高带宽写入与读取性能,并涵盖了不同规模的模型训练过程中常见的IO模型。通过下表我们可以看到每个测试场景的关键参数:测试数据量、典型场景和特定规格。

另外还必须确保测试数据的质量和权威性,为了保证最终测试结果的准确性与权威性,我们制定了一系列严格的操作规范,如表所示。

高计算性能

“V2.0”强化了对训练任务中存储系统的关注,旨在避免其成为效能制约因素。

·对于ResNet-50和3D UNet测试中的GPU使用要求为高于90%。

·CosmoFlow测试中,GPU利用率要求 >70%。

在新版MLPerf®Storagev2.0测试中,可采用更大的GPU模拟集群,以满足更高带宽与更佳延迟的工作负载要求。

请注意:禁止缓存优化。

·主机层面需避免所有形式的数据缓存措施,以防止对存储系统的真实性能评测产生干扰。

请先清空系统中的缓存,以确保测试结果的准确性。可以使用echo 3 > /proc/sys/vm/drop_caches命令来完成清理工作。

·至少使用主机内存容量的五倍量的数据集以确保数据来自存储的真实读取。

必须每一轮测试时都重置数据以避免隐形缓存。

3. 可重现性与审核制度

·完成训练任务至少五次以及Checkpoint任务十次的执行。

·提交结果需附带完整配置、日志与运行脚本。

在 ML CommonS 官网,你可以查询并获取该平台的公开测试流程及所需硬件配置。

所有的测试数据都经由主办方和参加实验的生产厂家双方交叉审核。

要深入了解关于MLPerf® Storage2.0基准测试的内容,请先了解一些关键概念。

加速器号(Acc Num):用来评估模拟测试时 GPU 的数量。在使用加速器测试的时候,这个数值越多,意味着系统要处理的负载会更大。

测试过程中 GPU的平均利用率,表示存储系统能否为 GPU 提供稳定且持续的数据供应能力。如果利用度较低,表明存储效能可能是影响因素。

Accelerator Type: GPU类型,私家侦探,侦探公司,调查公司,查人找物,商务调查,出轨外遇调查,婚外情调查,私人调查,19209219596表示参与测试的GPU型号/架构,MLPerf® Storage v2.0测试目前支持模拟测试A100和H100两种GPU类型。

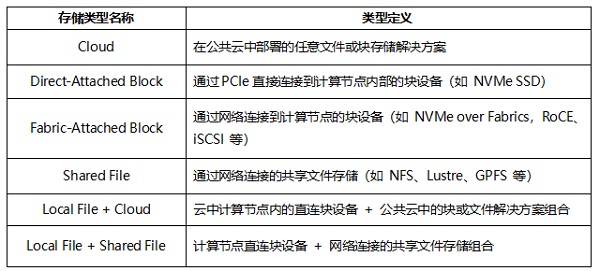

存储系统类型:参与测试的存储系统的结构和介质类型。在 MLPerf® Storage v2.0 测试中,我们覆盖了以下类型的存储系统:

Storage System 所需占用的物理空间,单位为Rack Unit(R1、RU = 1.75 英寸)。注:部分Cloud类型的参测厂商未提供其实际使用的存储系统RU数据,因此在本文中并未将这部分参测厂商的数据带宽纳入比较。

根据这些评估标准,就可以全面地比较参测厂商的系统性能。

为了在满足官方规定的GPU利用效率前提下,能够提供更多的GPU以及更高的业务宽带能力,请问哪一个存储解决方案可以做到?

·在同等训练模型下,哪个存储系统处理数据的速度更高?即每个RU所能提供的输入和输出带宽更多?

·哪台存储系统的性能密度高,在相同的检查点模型中,即在相同条件下,哪个存储系统的输出的每RU读取和写入带宽较高呢?

更高性能密度意味相同的节点数与机架空间中,能支持更多的GPU计算任务。

领先一步,全面第一! 泛联信息在MLPerf® Storage v2.0测试中独占鳌头。

泛联信息(UBIX)作为国内唯一全面参与MLPerf® Storage v2.0全部10项测试场景的创新型AI存储厂商,在众多国际领先参测企业中脱颖而出,并且斩获其中7项世界第一的卓越成绩。除此之外,其在所参与的测试项目中,相较于1.0版本的核心测试指标普遍实现了两倍以上的性能提升,充分展现了其在AI存储领域的技术实力与持续创新能力。

泛联信息(UBIX)利用自家独立拥有知识产权的UbiPower18000全闪存储解决方案参与本次测试,此次测试环境是由泛联信息的战略合作伙伴新疆银丰智能算力技术有限公司提供的一流AI算力和网络平台搭建而成。这两个平台由高品质的AI算力资源以及高速的网络架构结合在一起,为当前测试提供了稳定而可靠的基础。在存储介质方面,泛联信息使用了大普微Roealsen®R6系列PCIe Gen5NVMe SSD,在本次的测试过程中始终保持着极低的读写时延,并且有稳定的读写带宽表现,这对于高负载、密集型训练场景来说提供了非常强有力的支撑。

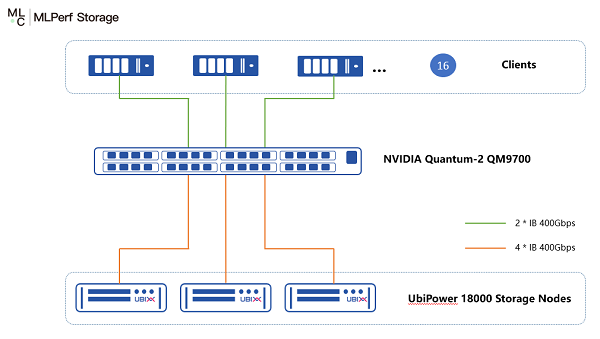

本次UbiPower 18000测试环境包含了一个具有三个节点的分布式集群(每个节点配置了16块大普微Roealsen R6100 15.36TB NVMe SSD和四张英伟达NVIDIA ConnectX-7 400Gbps IB网卡)以及十六台GPU算力服务器,网络拓扑如图所示。

这是UBiPower 18000的测试线路图

接下来,我们将对泛联信息(UBIX)UbiPower 18000分布式全闪存在本次性能测试中的详细数据进行深入解析,全面分析其在智算训练业务场景中所展示的突出表现。让我们共同见证这款专为智能计算环境量身打造的新锐AI分布式存储系统所展现的强大性能和创新价值。

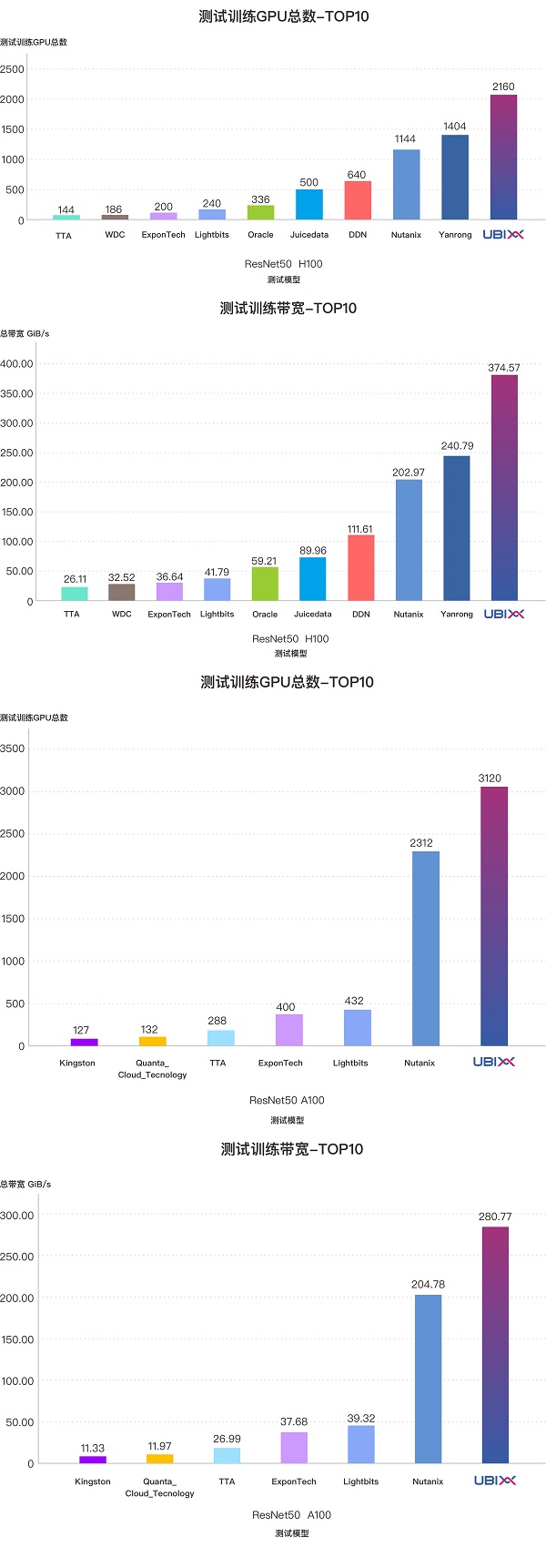

ResNet-50模型测试用样本解析

在ResNet-50模型的模拟测试中,测试系统的模拟图像分类任务使用了生成的ImageNet风格的数据集,并通过UbiPower 18000分布式存储系统多并发读取的I/O模式来评估数据吞吐量。在这一测试场景下,3个2U存储节点组成的系统成功地满足了多达2,160张H100 GPU的数据处理需求。GPU利用率始终保持90%以上,并且系统稳定带宽达到了374.57 GiB/s,每RU的带宽高达62.43GiB/s。同时,该系统能够满足3120张A100 GPU模拟训练的需求,即使如此,其GPU利用率仍然保持在90%以上,并且系统的稳定带宽也达到了280.77 GiB/s,每RU的带宽为46.8GiB/s。

在本测试模型中,UbiPower 18,000 在 支持的最大GPU数量、系统的总带宽以及每存储RU带宽等方面均位列首位,充分展现了其在处理大规模数据集场景中的卓越能力。同时,在有限的机架空间内提供了更高的性能密度,证明 UbiPower 18000 能够支持更多 GPU 计算节点高效训练任务,并且具有极强的可扩展性与部署效率,能够有效提升计算资源的使用效率,满足大规模数据集处理需求。

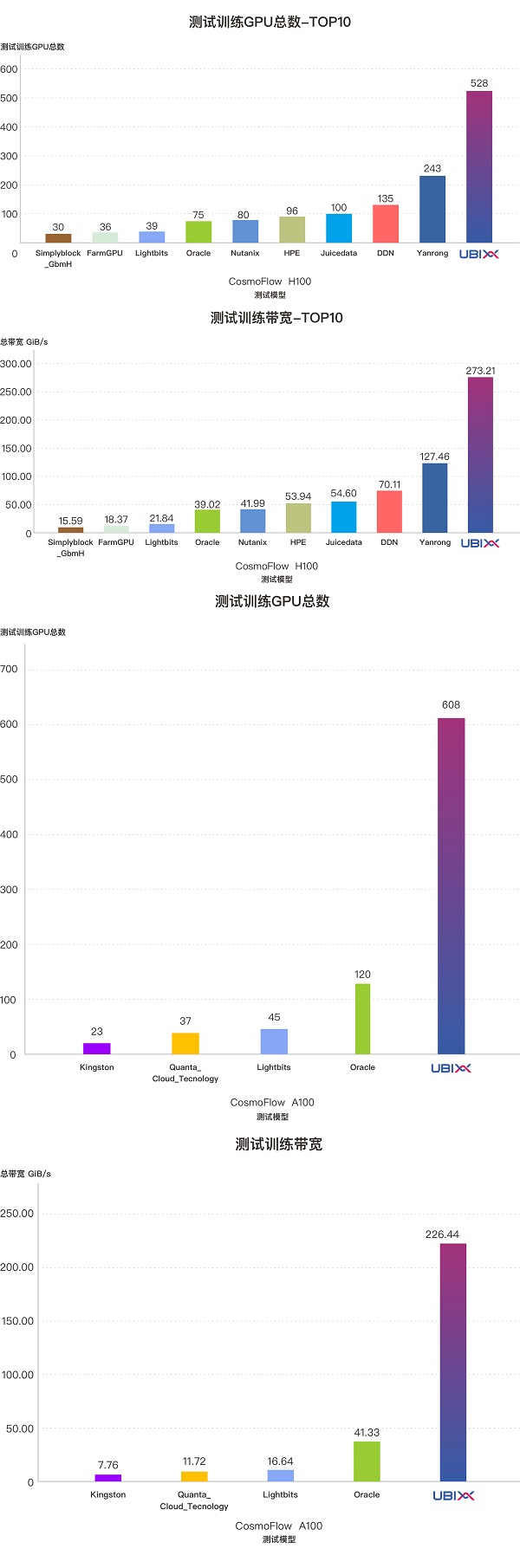

对于CosoFlow模型进行的数据解析工作。

该测试模型模拟了科学计算类AI工作负载,根据内存容量动态生成2.6MB大小的科学模拟数据文件,并采用并发读取的IO模型进行训练评估。UBIX使用512GB客户端内存,在此基础上,测试程序共生成约1500多万个科学模拟数据文件,成为所有参测厂商中数据集规模最大的测试样本。在这种大规模的数据集中,UbPower 18000分布式存储系统依然展现出卓越的性能:

已成功完成对于包含528张GPU的H100训练系统模拟要求,其可达到273.21 GiB/s 的稳定带宽。此系统的每RU带宽将高达45.54 GiB/s,体现了该产品的高性能水平。

实现了对608张 A100GPU模 拟训练带宽的需求,并稳定在了 226.44Gib/s的带宽水平,同私家侦探,侦探公司,调查公司,查人找物,商务调查,出轨外遇调查,婚外情调查,私人调查,19209219596时,每台存储系统RU的带宽能达到37.74Gib/s。

这款测试模型中,Ubipower 18000在适用GPU的数量、总系统带宽以及每存储系统的RU宽带等方面,均处于所有参测厂商中的顶尖水平。无论面对更大规模的数据集或者更严格的I/O压力,Ubipower 18000依然能够支持远超过其他厂商的GPU数量和集群带宽,充分展现了这款产品在科学计算类AI训练负载场景下出色性能以及出色的扩展能力。

3D U-Net模型测试数据解析

该测试模拟了医学影像分割任务典型的工作负载,主要用于评估存储系统应对混合读取模式以及中等文件大小(约140MB)场景时的整体表现。在此模型下,UbiPower 18000 存储系统的性能能力也得到了体现。

·系统能有效应对训练集为336张A100 GPU规模的模拟培训工作。

在训练中,GPU的利用保持在一个稳定而持续的水平上,即始终保持在90%以上的水平。

系统可实现最大455.05Gbps的稳定的传输能力。

·折合每存储系统RU带宽达到75.84GiB/s。

在该测试模型下,UbiPower 18000 支持的 GPU 数量、总带宽及每存储系统 RU 带宽均处于所有参测厂商中的最高水平,充分展现了其在医学影像类 AI 负载下的领先性能与强大适应性。

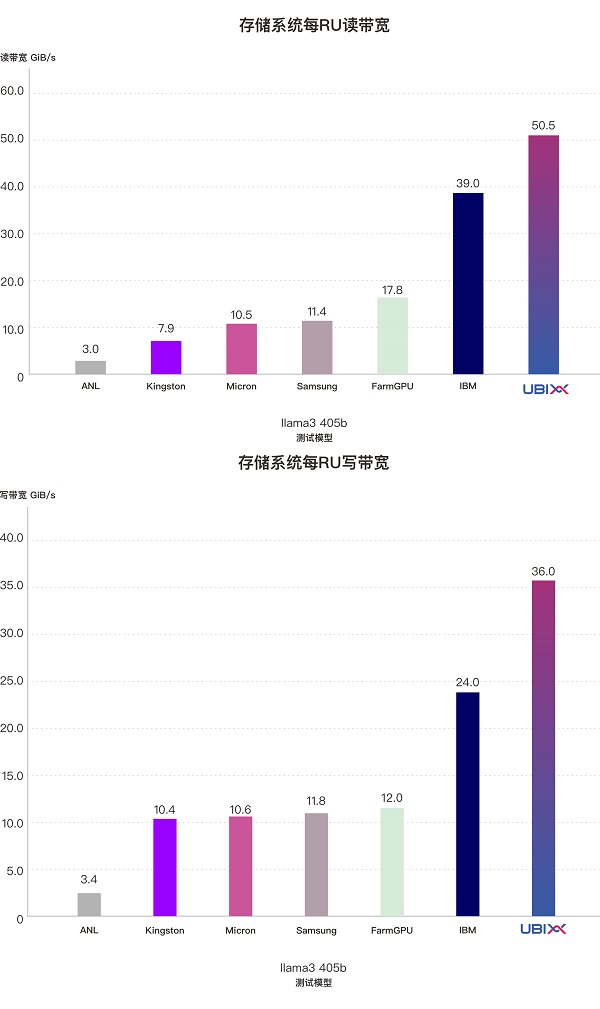

Llama 3 - 405b 的模型测试数据分析

Llama3 405b模拟的是在企业或高校规模训练中进行批量模型存档时的典型场景,多个GPU服务器并行运行数据读取和存档过程。在MLPerf® Storage v2.0测试中,该模型模拟了每轮包含512路并发写入与读取操作,总容量达到5.29TB的存档文件流程,并重点考察存储系统上并发读写的带宽性能以及大型计算集群下并发访问的性能指标。

在这个测试模型中,我们通过配置三个2U存储节点构建了一个UBI Power 18000存储系统,它的表现令人印象深刻,每个存储系统都提供了稳定的输出,其RU每秒能够提供50.5 GiB/s的读带宽以及36 GiB/s的写带宽,这两个值均高于所有测试厂商中任何其他产品。

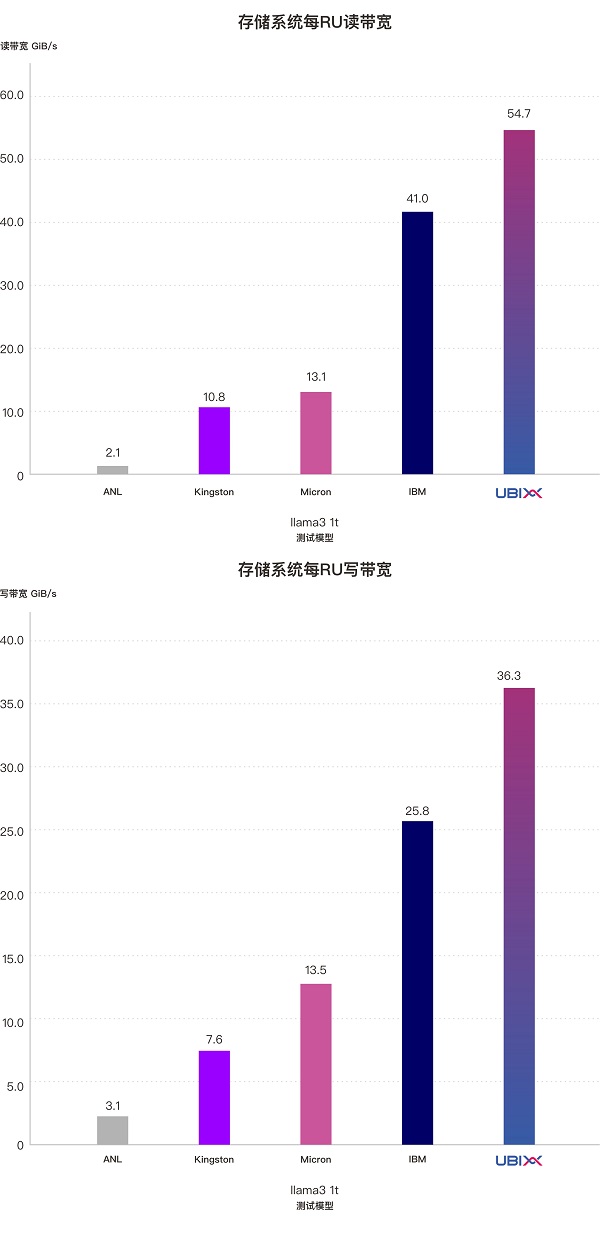

Llama3-1t模型测试数据解析

Llama-3t 模型所展示的是,在超大规模AI基础设施下的多个GPU服务器进行全量并发读写操作的场景模拟,其规模涉及多达一千二百四十个独立的数据读写请求,以及每轮数据总量超过十八TB的大容量存储系统访问。

在这个测试中,我们配备有三个2U存储节点的Ubipower 18000存储系统,每R U稳定提供54.7吉字节/秒的读取速度和36.3吉字节/秒的写入速度,再一次刷新了参测厂商中的读取与写入带宽密度记录。

通过对比Llama3-405b和Llama3-1t两个Checkpoint模型在高并发读写场景下的性能表现,可以看出Ubipower 18000存储系统的传输速率表现出色。

·系统读带宽突破328GiB/s,写带宽超过218GiB/s

每个节点可为客户提供高达100 GiB/s的读速度以及72 GiB/s的写速率

这些数据充分表明了UbiPower 18000 在大型模型训练过程中对于checkpoint保存与加载场景下的突出表现。此外,在节点数量按照线性方式进行扩展的情况下,该系统能够在确保集群整体读写带宽持续提升的同时,满足大规模AI训练对存储系统的极致需求。

泛联信息(ubix):致力于引领智算时代的新一代数据储存技术与应用

作为一家专注于AI 存储产品与解决方案的新锐厂商,深圳市泛联信息科技有限公司(UBIX Technology Co., Ltd.) 在存储介质技术、系统架构以及应用软件等方面不断创新突破,在研发上成功打造出具有自主知识产权的高性能分布式文件系统UBIXFS,体现了公司持续的技术创新和强大的研发实力。

它的一些关键技术是:

• 全固态分层资源池架构

·一个高并发并且实时的分布式元数据服务群组

基于RDMA的多路径动态聚合快速数据传输协议

CSN提供资源的虚拟化与统一管理服务

这一改进显着提高了整个存储系统的性能,为支持智能计算和超算环境中的苛刻需求提供有力支持,并且是促进人工智能技术成熟及应用的强有力推进动力。

目前,UBIX已将其创新AI存储产品部署于多个超算中心和智算中心,该解决方案广泛用于数据预处理、访问海量数据、大规模读写Checkpoint等多种关键应用场景,并在科研领域、高性能计算(HPC)以及文本、图像、视频等模态的大模型训练任务中得到验证。

展望未来,泛联信息将坚定不移地深化在AI 存储领域的研发与投资,将高性能、高可靠性和智能化三大方向作为重点继续加大投入力度,不断优化系统架构及软件能力,以推出更多满足大模型训练、智算与超算中心需求的领先产品和解决方案,助力全球用户应对未来AI时代的挑战。

如您欲获知UBIX的产品更多详情并获取技术支持,请访问泛联信息的官方网址www.ubix.cn。

顶: 744踩: 34341

评论专区