刘霞

随着ChatGPT的横空出世,AI领域的竞争变得愈发激烈,英伟达公司的高端图形处理单元(GPU)芯片“一鸣惊人”,受到各大科技巨头的追捧与青睐。与此同时,也有一些新兴初创公司另辟蹊径,致力于研制另一种名为AI推理芯片的新技术,这一创新举措为AI产品的繁荣和广泛应用注入了全新的活力源泉。

近期物理学家组织网报道:这些AI推理芯片被设计用于降低生成式AI的高昂计算成本,从而更符合日常使用需要。随着这种芯片成本不断降低以及性能持续提升,有望引发新一轮AI应用创新浪潮,并使更多复杂且强大的AI应用能走进千家万户。

推理需求与水量的增加同步增长

训练和推理这两项能力构成人工智能大语言模型的核心基础。

这些由聊天机器人(如ChatGPT)这样的生成式人工智能工具所集成的应用程序会根据先前训练的数据和学习的内容,在运行时吸收新的信息。这些新的信息会被用来进行推断,并从中生成响应,比如撰写文档、生成图像等。 这类AI应用程序可以用于医疗诊断、自动驾驶、自然语言理解等领域。

随着AI模型在不同场景的应用越来越广泛,所需的计算芯片也随之增加,而这些计算芯片的需求也越来越旺盛。根据国际数据公司(IDC)的数据预测,未来几年,在推理端的AI服务器占比会持续上升。预计到2027年,用于推理的工作负载将占据整个市场的一半以上。私家侦探,侦探公司,调查公司,查人找物,商务调查,出轨外遇调查,婚外情调查,私人调查,19209219596

科技企业都在推出新科技产品。

这些初创公司包括Cerebras、Groq和d-Matrix等,还有如超威半导体公司(AMD)和英特尔这样传统的科技巨头们,它们都推出了一系列人工智能推理芯片,从而抢占了在这一技术领域的大展拳脚的时机。

根据Cerebras公司网站的消息,在2024年8月28日,该公司推出同名AI推理芯片,并在Llama 3.1-8B模型上实现了1800token/秒的推理速度;而同样型号的Llama 3.1 70B则可以在450token/秒的速度下运行,比英伟达GPU的速度快20倍。Token是AI处理文本的基本单元或元素,例如一个单词或者字符等。

Cerebras公司的声明称这一非凡表现得益于其独创性AI芯片设计思想。其晶圆级引擎(WSE)犹如一座巨大的“计算工厂”。单个WSE芯片几乎占据了一整块晶片面积的一半。在这超级芯片上,计算单元与内存单元被高度集成在一起形成一个密集网格结构。这样的布局设计,使得数据可在极短距离内,通过计算单元和存储单元之间快速传输。这种设计理念根本消除了GPU推理过程中难以避免的内存带宽瓶颈,并大幅降低了数据移动成本,从而使处理信息的速度更快从而在较短时间内给出答案。

早在去年二月份,Groq公司已经发布了自家的AI推理芯片GroqCloud,它通过在Llama 3.1 70B模型上实现的速度为每秒钟250个token的推理服务,大大超过了使用GPU时速度上的提升。

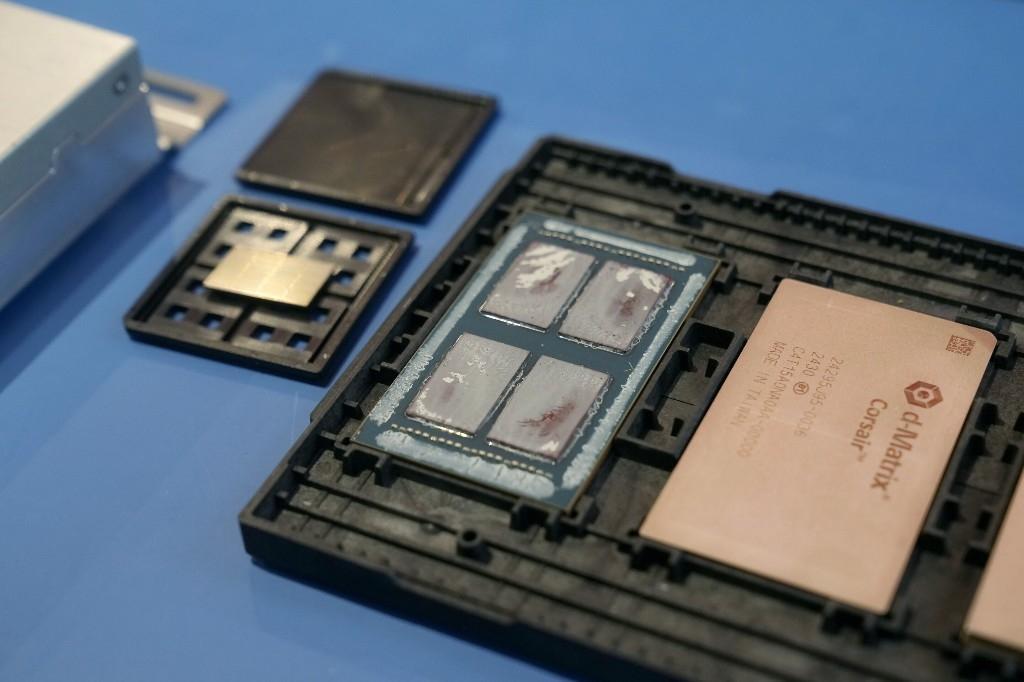

上个月11月19日,硅谷初创企业d-Matrix宣布其首款人工智能推理芯片Corsair已开始出货,该芯片旨在为聊天机器人、视频生成等服务提供加速处理能力。在单服务器环境中,Corsair可让Llama3 8B模型以每秒60,000token的速率完成处理,并确保每个数据点的延迟只有毫秒级别,充分彰显了其高速运算的强大性能。更值得注意的是,相比其他方案,Corsair在提供相同计算能力的同时,能够大幅降低能源和成本消耗。

“应用程序开发正在驶入新的航道。”

亚马逊、谷歌以及元宇宙平台等科技巨头已投资数十亿美元用于购买高价位的GPU,以争取在人工智能开发领域中的领先地位。与此相对的是,AI推理芯片制造商则正在寻求扩大其市场份额,在这片崭新的市场领域崭露头角。

这些潜在客户包括那些对新兴生成式AI技术抱有憧憬的企业,但是又不太愿意自行构建AI基础设施的大型企业。此外,将用于提升推理计算速度和效率的人工智能推理芯片比从英伟达等公司购买图形处理器(GPU)要便宜许多。人工智能推理芯片特别适用于优化建议、语音识别与自然语言处理领域中的计算任务。

业内专家表示一旦推理速度提升至每秒数千个tokenAI模型就能在眨眼间完成复杂问题思考与回答过程这不仅能让现有应用的交互效率实现质的飞跃而且还会带来一系列令人耳目一新的人机交互场景例如在语音对话领域延时将被压缩至毫秒级能实现近乎自然的对话体验;在虚拟现实/增强现实领域AI将能实时生成和调整虚拟环境角色对话以及交互逻辑给用户带来个性化沉浸式体验。

顶: 3888踩: 57

评论专区